- Accueil DeVinci Executive Education

- Articles

- IA génératives : comprendre, apprendre et expérimenter, par Joachim Massias

IA génératives : comprendre, apprendre et expérimenter, par Joachim Massias

12 juin 2023

Joachim Massias interview Laurent Cervoni

Ces « regards croisés » débutent avec Laurent Cervoni, directeur du Centre de Recherche et Innovation du groupe Talan et professeur référent du MBA en Intelligence Artificielle et Data Innovation de Devinci Executive Education. Ils s’inscrivent dans une série d’échanges sur le décryptage des enjeux sociétaux et technologiques. Il aborde nos travaux dans ces domaines et les projets de recherche que nous menons pour faire avancer la compréhension de ces technologies pour tous. Dans ce premier volet, qui sera en plusieurs parties, nous décryptons les IA génératives et leurs perspectives dans le quotidien de tous.

Pouvez-vous expliquer ce que sont les IA génératives pour ceux qui ne sont pas familiers avec ce terme ?

Laurent Cervoni : Il existe différentes catégories d’intelligences artificielles. Les IA génératives ne sont qu’une partie d’entre elles. Il existe également ce que l’on appelle des IA dites prédictives qui ont pour vocation de prédire des événements. Ensuite, nous pouvons parler des IA théoriques, la plus connue étant l’IA forte ou IA générale. Bref, il existe un très grand nombre d’intelligences artificielles. Comme leur nom l’indique, les IA génératives vont générer du texte (ChatGPT, Bard, Llama, etc.), des images (Midjourney, Stable Dissusion, Dall-E), du son ou de la vidéo (Runway Gen-2). Cette génération se fait à partir de contenus, textes, images, sons, etc. en quantité gigantesque qui ont servi de base d’apprentissage à un algorithme afin de créer une base de paramètres, les fameux milliards de paramètres dont tout le monde parle. Le deuxième élément de génération est la requête de l’utilisateur. Cette requête va permettre à l’algorithme de générer le contenu souhaité par l’utilisateur. C’est la combinaison des données d’entrée, qui ont constitué, finalement, l’apprentissage de ces IA, son « savoir-faire » et la requête d’un utilisateur qui font que l’algorithme va générer du contenu à partir de ces deux éléments. J’insiste sur le fait que, bien que l’on utilise le mot « intelligence » dans « intelligence artificielle », cela reste de l’algorithmie et non l’émergence d’un quelconque équivalent d’une intelligence humaine. Il me paraît donc essentiel de bien différencier les IA génératives, celles dont tout le monde parle aujourd’hui, des IA réactives, IA prédictives, des IA symboliques, etc.

Joachim Massias : Mettre du sens derrière le terme « IA génératives » fait partie des urgences. On lit tout et n’importe quoi sur ce sujet et les phantasmes les plus fous comme des suppressions d’emplois par centaines de millions, la disparition de l’humain, etc. s’emparent des uns et des autres. Je le perçois même au sein de notre MBA en intelligence artificielle et Data Innovation ou chez nos clients. Il faut, sans cesse que nous restions attentifs aux discours, aux déformations, et revenir, avec nos interlocuteurs, aux fondamentaux pour combattre les peurs. Sinon, les prises de décision au sein de projets peuvent être délétères en fonction des partis pris. Les IA génératives correspondent à un petit pan du spectre des intelligences artificielles. Il est amené à fortement croître. Il faut donc être vigilants et ne pas penser les législations, les préventions, les règles de manière manichéenne.

Quels sont les principaux usages des IA génératives ?

Joachim Massias : Les cas d’usage des IA génératives sont nombreux et dans des domaines complètement différents. Génération de textes, d’images, génération de protéines ou de nouvelles molécules, génération de nouveaux matériaux. On peut également inverser l’usage en transformant un outil comme ChatGPT en véritable coach qui vous pose des questions afin de réfléchir sur une thématique, de mieux connaître un sujet ou de s’entraîner à débattre.

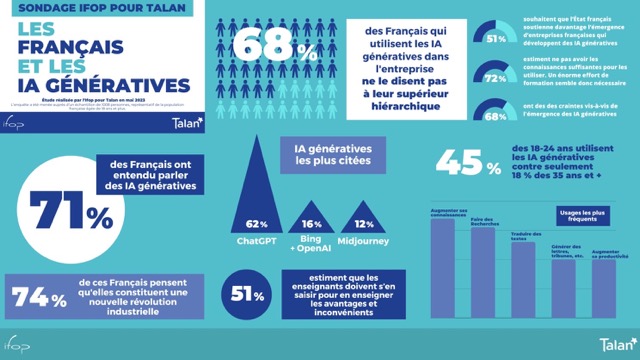

Un récent sondage intéressant de l’Ifop pour Talan « Les Français et les IA génératives » éclaire sur les usages principaux des Français. Sans surprise, c’est l’IA générative d’OpenAI, ChatGPT, qui est de loin la plus utilisée.

Les IA génératives servent principalement aux Français à augmenter leurs connaissances, effectuer des recherches comme dans un moteur de recherche, traduire des textes, augmenter leur productivité, générer des lettres de recommandation, des tribunes, des e-mails, augmenter leur créativité, augmenter leurs connaissances. Les deux premiers usages nécessitent d’ailleurs des préventions car ChatGPT est connu pour générer, du fait de son modèle de fonctionnement, de nombreuses erreurs reconnues par le CEO d’OpenAI lui-même. Ce que l’on peut remarquer, c’est que de nombreux professionnels utilisent la génération d’images pour leur permettre d’accroître leur productivité et faciliter la recherche de nouvelles idées. Des exemples récents comme l’outil remplissage génératif d’Adobe Photoshop sont fascinants tant la qualité de génération de nouveaux objets dans une scène grâce à de simples phrases est simple et performant. Les présentations de Microsoft Copilot, de Google Bard montrent une intégration des IA génératives très intéressante qui va changer les habitudes des collaborateurs et nécessiter de faire de l’accompagnement au changement de manière massive.

Laurent Cervoni : Nous avons, dans mon Centre de recherche et Innovation de Talan, testé depuis de nombreux mois des centaines d’usages des IA génératives pour mieux appréhender les avantages et limites de ces IA et mieux mesurer les applications possibles au sein de l’entreprise et pour nos clients. Nous testons les IA génératives online comme ChatGPT d’OpenAI, Bard, Bing avec l’intégration d’OpenAI autant que celles qui s’installent localement comme Lama de Meta et d’autres encore. En plus des usages déjà cités par Joachim, un des usages qui monte énormément, c’est l’utilisation des IA génératives pour le développement informatique. Des développeurs les utilisent depuis maintenant plusieurs années pour générer du code. On se dirige vers une généralisation de cet usage du fait de l’intégration des IA génératives dans les éditeurs de code. Cela ne permet pas de produire de grands volumes de code, pour des raisons de fiabilité du code généré ou des risques de cybersécurité mais cela reste un usage très pratique.

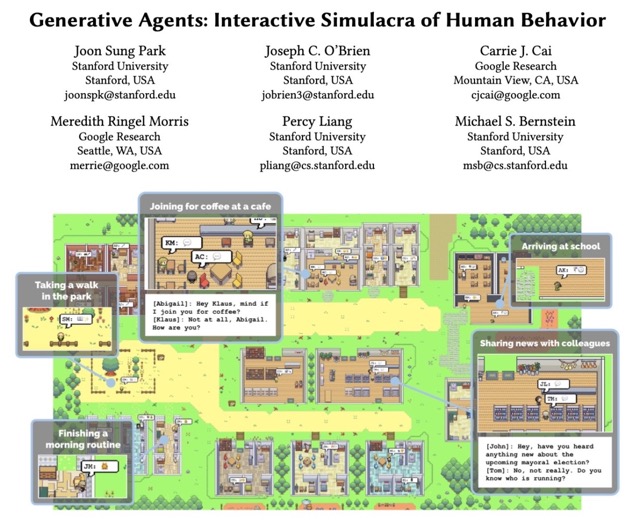

Les IA génératives sont aussi utilisées dans le développement de jeux avec la génération de scénarios de jeux intéressants. Surtout, si on utilise une IA générative de manière dynamique, sans que ce soit préprogrammé, on peut avoir des scénarios de jeux qui sont moins prévisibles que s’ils étaient préprogrammés. On peut d’ailleurs faire le parallèle entre ces scénarios de jeux et des scénarisations en entreprise (gestion de crise, interactions en entreprise, etc.). Dans les domaines artistiques, on peut générer de la musique, du dessin, des images. Pour le coup, Internet est déjà saturé d’images produites avec des IA génératives, pour le meilleur comme pour le pire.

Comment voyez-vous le rôle des IA génératives dans l'art et la créativité ?

Joachim Massias : C’est un sujet qui me touche particulièrement puisque, dans mon parcours, je suis issu des métiers artistiques. J’étais violoniste professionnel jusqu’à l’âge de 28 ans dans différents grands orchestres français et issu d’une famille de musiciens et compositeurs. La création assistée, c’est un domaine que je suis de prêt depuis longtemps à travers le travail sur des œuvres contemporaines et les travaux de l’IRCAM. Je suis, sur ce point, très optimiste et peu enclin à croire que les IA génératives vont remplacer une majorité d’artistes et de créateurs.

Je crois, bien au contraire, que l’émergence de tels outils permet d’augmenter considérablement la créativité, de multiplier les possibles. De la même manière que sont arrivés les synthétiseurs, qui ont permis d’ouvrir la musique électronique à beaucoup de gens, je pense que les IA génératives vont permettre à énormément de personnes de créer et d’inventer. D’ailleurs les créateurs ne s’y sont pas trompés et se sont massivement rués vers ces IA génératives. Il s’agit beaucoup plus d’une augmentation des capacités humaines que de son éventuel remplacement. Et les tests auprès de dizaines et dizaines de personnes que nous avons pu mener ces derniers mois vont dans ce sens.

Je ne crois pas au grand remplacement !

Par exemple, les métiers de l’audiovisuel vont devoir s’adapter à la « génération à la demande » de vidéos. Le métier des scénaristes peut se trouver chahuté. D’ailleurs, il y a un combat en ce moment aux États-Unis avec l’un des principaux syndicats de scénaristes qui avait décidé d’accepter l’usage des IA génératives dans l’univers des créations audiovisuelles (films, séries, etc.) contre l’avis des scénaristes.

Bien sûr, des personnes vont se retrouver en difficulté. Bien sûr des métiers vont évoluer et notamment dans le domaine des métiers artistiques. Il faut accompagner ce changement, comprendre les enjeux, former, former, former. Et surtout prendre en main les outils, réfléchir à leur usage et si on s’en sent l’envie, s’approprier ces technologies.

Laurent Cervoni : Comme l’a dit Joachim, depuis très longtemps, l’informatique a pénétré les métiers artistiques. Par exemple, dans la musique, on a eu effectivement un énorme débat sur la musique électronique qui viendrait remplacer la musique acoustique. Globalement, cela n’a pas remplacé les musiciens et cela a, au contraire, créé des vocations. Dans toutes les facettes de l’art, je pense que les IA génératives viennent apporter un outil supplémentaire.

D’ailleurs, la caractéristique d’ « hallucination » des IA qui est une dérive de fonctionnement par rapport à ce qui est attendu peut être intéressant parce qu’elle va à certains moments produire des choses qui sont surprenantes mais inattendues et involontaires. Dans le domaine de l’art cela peut être intéressant.

Maintenant n’oublions pas les limites des IA génératives du fait de la manière dont elles sont entraînées. Si on prend l’exemple des images, elles ont, pendant très longtemps, généré des personnages qui avaient 5, 6, 7 doigts car les bases d’entraînement comprenaient très peu de mains dans de nombreux contextes et angles de vues. Du coup elles ne savaient pas comment étaient constituées les mains d’un humain. On voit bien qu’elles n’ont pas de représentation de l’environnement et n’ont aucun bon sens.

Pour approfondir, Il y a un type d’art dans lequel aujourd’hui elles sont bien pauvres par rapport au reste, c’est l’art magique. Elles sont incapables de créer, d’imaginer un tour de magie. Un tour de magie fait appel au bon sens. Pour un être humain, quelque chose est magique parce que ça n’est pas possible, il se passe quelque chose qui n’est pas possible. Or pour qu’une IA comprenne que quelque chose qui n’est pas possible se produit, c’est très complexe de l’entraîner dans ce sens-là. Donc si on lui demande de créer un tour de magie, elle ne va pas savoir le faire même à partir de toutes ses connaissances livresques. Elle va cloner quelque chose et être assez pauvre finalement dans sa créativité. On le voit spécifiquement sur ce type d’art là, parce que c’est flagrant, qu’elles n’ont pas de bon sens ni de compréhension de l’environnement. Si on extrapole à la musique ou à la peinture c’est la même chose. Elles ne savent pas représenter un tableau à partir de ce qu’elles voient puisqu’elles ne voient pas. Or l’artiste, quand il va regarder un paysage, il va donner une interprétation du paysage. Finalement c’est bien l’artiste qui va lui demander de générer quelque chose, donc c’est encore l’humain qui va garder le savoir-faire là-dessus.

Quels sont les principaux inconvénients ou dangers des IA génératives que vous voyez actuellement ?

Laurent Cervoni : Le principal danger que je vois, c’est une mauvaise compréhension de ce que c’est réellement. C’est-à-dire qu’à partir du moment où on ne comprend pas ce que c’est, on fait un peu n’importe quoi avec. D’ailleurs, 72% des Français estiment ne pas avoir les connaissances suffisantes pour utiliser les IA génératives. Comment, dans ces conditions, ne pas leur prêter des capacités ou des intentions qu’elles n’ont pas. La première chose à bien comprendre, c’est que, justement, elles n’ont aucune intention. Encore une fois, le mot intelligence vient troubler. Les IA génératives n’ont pas pour intention de dominer le monde et de venir remplacer l’être humain. Cette mauvaise compréhension crée effectivement des mauvaises utilisations.

Maintenant, il y a effectivement des dangers. Un utilisateur malveillant peut générer une image qui se confond de manière quasi imperceptible avec la réalité. On pourra dans quelques jours, au moment où cet article paraîtra, produire des vidéos qui ressemblent à s’y méprendre à la réalité. On peut, d’ores et déjà, cloner une voix de quelqu’un à partir d’un enregistrement d’une dizaine de minutes qui peut influencer des auditeurs. C’est là qu’est le principal danger. Cela va contribuer à la génération massive de fake News, donc de fausses images, vidéos et prises de parole. Les exemples déjà célèbres où l’on voit Donald Trump se faire arrêter, où Emmanuel Macron en éboueur, où le pape est vêtu d’une doudoune blanche ont fait le tour du monde.

Si on regarde de près Donald Trump, de nombreux défauts trahissent l’image.

Mais tous ces détails-là disparaissent déjà avec les mises à jour des plateformes et les futures images, sons ou vidéos ressembleront véritablement à la réalité. Le danger est effectivement que l’on puisse les prendre pour argent comptant comme si c’étaient des images réelles ou des contenus réels. C’est le principal danger avec la mauvaise utilisation des IA génératives.

Joachim Massias : pour compléter ce que dit Laurent, je crois que l’un des enjeux majeurs, c’est d’abord la manière dont ces IA génératives ont été formées. A savoir, avec quel corpus, quelles données, elles ont été entraînées. Notamment, ChatGPT a été entraîné massivement sur des données anglo-saxonnes. Cela pose question. Prenons un exemple souvent cité dans le domaine de l’IA pour comprendre le problème des biais d’entraînement. Si vous voulez « augmenter vos connaissances » comme l’indiquent en première place les Français avec l’utilisation de ChatGPT, en échangeant avec cet outil sur un sujet comme les rois de France, on peut s’interroger sur les données d’entraînement qui ont permis à ChatGPT d’intégrer ce sujet. S’agit-il de données issues de manuels américains, anglais ou, pourquoi pas, japonais marqués par des particularités culturelles spécifiques qui ont servi à analyser ce sujet ? ou de données provenant de manuels Français avec notre vision propre, ainsi que nos propres interprétations ? Il est donc important de savoir, de comprendre à partir de quelles données ces IA ont été entraînées afin de mieux percevoir quels types de biais seront présents dans les réponses.

Ensuite, il me paraît essentiel de contrôler la présence des pré-prompts dans les IA génératives, c’est à dire ces prompts qui sont construits par l’éditeur de l’IA avant que l’utilisateur entre son propre prompt. Il sert principalement à encadrer les usages et éviter que certains puissent avoir des usages dangereux de ces IA par des questions de construction d’armes, de pratiques sexuelles extrêmes, etc. Des IA sortent déjà sans présence de ces pré-prompts et sont utilisables sur des ordinateurs locaux. Il convient, dans ces cas particuliers, de mettre en place les contraintes nécessaires.

Comme l’a évoqué Laurent, un autre risque important des IA génératives est leur capacité à produire en grand nombre des contenus qualitatifs, réalistes dans le but d’influencer. Les fake news existent depuis longtemps, soit sous forme de textes ou d’images dans le cadre de conflits armés, d’élections. Ce n‘est pas un phénomène nouveau. La nouveauté c’est la diffusion quasi instantanée et massive de ces contenus sur les réseaux sociaux avec beaucoup de difficultés pour les invalider en temps réel.

Le risque est de se retrouver confrontés à des situations très bien décrites dans la série The Capture ou la mémorable Black Mirror. Concernant les images, il existe tout de même des solutions pour faciliter la détection de contenus truqués ou générés.

Un logiciel français comme TunGstene, est déjà utilisé notamment par les autorités et par certains médias. Il permet, grâce à des filtres et de nombreuses fonctionnalités, de déterminer s’il y a eu un montage dans une image ou s’il y a eu génération automatique du contenu. Il existe donc déjà des outils puissants. Simplement, on ne les met pas forcément en œuvre. Un portage de ces solutions sur des outils de détection automatique en ligne devrait permettre de mieux lutter contre la diffusion de contenus à risque. Mais la tentation de facilité est souvent plutôt du côté de la dénonciation que de celle de l’action.

D’autres questions centrales doivent également nous préoccuper. Quels enjeux de cybersécurité ? Quelles sont les capacités de calcul nécessaires afin de générer ces vidéos ? Quel impact environnemental ?

Comment les réglementations actuelles traitent-elles les IA génératives ?

Laurent Cervoni : On légifère quand même déjà beaucoup pour réglementer les enjeux technologiques. On a évoqué précédemment les dangers liés aux IA génératives et il est humain de s’engouffrer dans le discours simpliste « face au danger, il faut de nouvelles lois ». Comme cela a été très bien rappelé par la CNIL, conceptuellement, le vide juridique n’existe pas en France. Peu de gens le savent, mais il ne peut pas y avoir de vide juridique, puisque par définition quand il y a un problème, un juge doit rendre la justice sinon cela s’appelle le déni de justice. Il s’appuie obligatoirement sur les lois qui existent. Le concept de vide juridique est donc un véritable abus de langage. D’autre part, beaucoup de lois existent déjà et permettent de répondre à de nombreuses interrogations. Par exemple, si on entraîne une IA en prenant des contenus protégés par le code du droit d’auteur, c’est le droit d’auteur qui s’applique. S’il y a des données personnelles lors de la publication, c’est le RGPD qui s’applique.

On peut effectivement imaginer des cadres supplémentaires qui vont venir préciser certains usages. Par exemple, si on prend les images qui sont générées de manière artificielle par ce type d’intelligence artificielle, on pourrait imaginer une sorte d’obligation des éditeurs à les marquer, à avoir une sorte de filigrane qui indique qu’elle a été générée par un algorithme. Mais on voit bien que c’est très limité. Cela va s’appliquer aux éditeurs officiels, hors, comme ce type d’IA est également disponible en open source, il est très facile, moyennant un petit savoir-faire technique, de les installer sur des ordinateurs personnels. Nous avons dans notre Centre de Recherche de nombreuses IA génératives installées localement et qui ne demandent aucune connexion à Internet. On se rend bien compte qu’il sera très difficile, voire impossible, de venir contraindre chaque individu à intégrer une mention « généré par une intelligence artificielle » sur ses productions. Il existe déjà des logos sur Internet que vous pouvez ajouter avec les mentions « généré à partir d’une intelligence artificielle », « utilisant de l’IA », ou « sans IA », mais qui sont très peu utilisés.

L’Europe est en train d’essayer de créer un nouveau cadre réglementaire comme elle l’a fait avec le RGPD, mais c’est un sujet qui est extrêmement délicat. Il faudra d’ailleurs mesurer l’impact de ces règles en fonction des pays qui devront s’y conformer et ceux qui s’en affranchiront. Par exemple, si on contraint trop les IA, des outils comme les LLM, typiquement ChatGPT etc. ne pourraient se développer que dans certains pays et pas dans d’autres. Du coup, on aurait une fracture entre les pays qui serait très importante. On peut prendre un exemple extrêmement concret, le patron d’OpenAI a été interrogé dernièrement devant le Sénat américain. Il a dit qu’il fallait un encadrement et il termine son interview en disant « c’est pour cela que le leadership des États-Unis est primordial ». On voit bien qu’il considère que c’est la culture, finalement le mode de fonctionnement américain, le leadership américain qui est primordial. Donc il y a un gros risque sur ces encadrements. Il faut, sans doute, définir des cadres de mise en œuvre, mais il faut faire en sorte que ces cadres ne soient pas limitants. Je pense que ce qu’il faut plutôt imposer et Joachim l’a évoqué, c’est une meilleure transparence. Quand vous savez comment une IA a été entraînée, quel est le type d’algorithme qui a été mis en œuvre, finalement, c’est comme dans un tour de magie, vous connaissez le truc et ça devient nettement plus décevant, moins magique. La transparence est pour moi la seule chose que je voudrais voir généralisée, donc l’open source, et chez TALAN nous militons pour l’open source.

Joachim Massias : Effectivement, la grande difficulté aujourd’hui c’est, comme sur de nombreux sujets, que tant qu’on ne sait pas de quoi on parle, c’est la porte ouverte à toutes les peurs. Et quand on a peur face à une situation que l’on ne comprend pas, on a, par nature, envie de légiférer, sans doute beaucoup trop vite, beaucoup trop loin, beaucoup trop fort.